不知道你有没有这样的感觉,现在用个AI应用,有时快得飞起,一点就开;有时候呢,它就像在“思考人生”,那个加载的小圈圈转啊转,让人等得心焦。你可能会怪网络不好,或者手机太旧,但很多时候,问题出在咱们看不见摸不着的后台——那个叫做 “AI加载进程” 的家伙身上。今天咱就掰开揉碎了讲讲,这个进程到底在忙活些啥,为啥它一“卡壳”,你的体验就掉线。

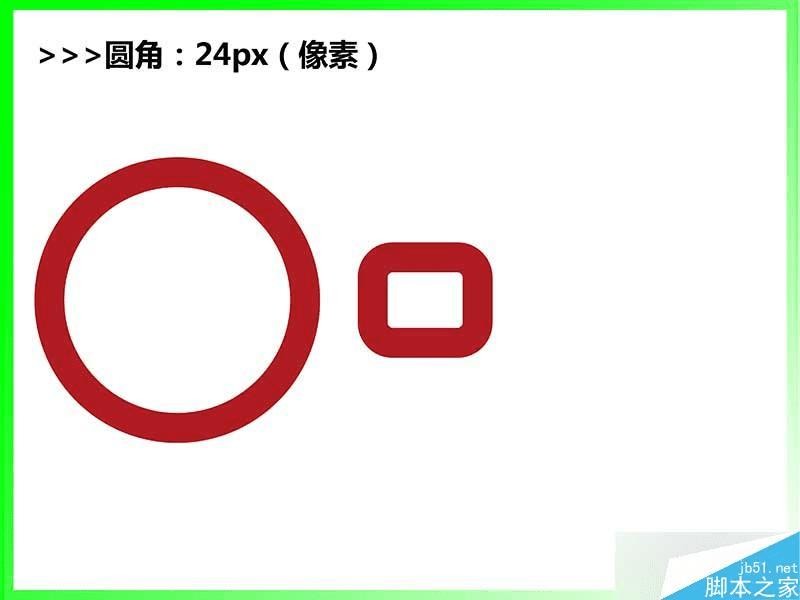

咱们得破除一个迷思。你以为你点开一个AI聊天窗口,是直接和云端那个庞大无比的模型对话吗?没那么简单。这中间有个非常关键的“前台接待”,就是AI加载进程。你可以把它理解为一个超级高效、专业的“模型调度师”。它的第一项工作,就是“招兵买马”,创建一个专属的推理环境。比如说,像Firefox浏览器里的AI功能,当你点击一个需要AI处理的按钮时,浏览器的主进程并不会自己上手算,而是会赶紧吩咐下去:“来个人,专门处理这个!”于是,一个全新的、特定类型的“推理进程”就被创建出来了-1。这个新进程上任后的第一件事,可不是立刻开始干活,而是“置办家当”——去加载运行AI模型所必需的核心工具包,比如ONNX运行时和Transformers.js库这些“专业软件”-1。这个过程,就像给一个厨师准备厨房和厨具,灶台(算力)是现成的,但锅碗瓢勺、油盐酱醋(运行时环境)得现摆出来。这个初始化阶段是否流畅,直接决定了AI功能能否成功启动,以及启动的速度。很多应用一打开就让你等半天,很可能就是这位“调度师”在准备“厨房”时遇到了麻烦,比如下载必要的组件慢了,或者本地存储找不到了。

厨房准备好了,接下来就该处理食材了。对于AI来说,最主要的“食材”就是需要加载的模型和海量的上下文数据。这里就碰到了当前AI应用最大的一个坎——内存墙。现在的模型动辄数百亿参数,一次对话的上下文(就是你和AI聊天的所有历史记录)也可能长达几十万、上百万个词(Token)。这么庞大的数据,想全部塞进显卡那珍贵又昂贵的高速显存里,简直就是天方夜谭。这就引出了AI加载进程第二项核心智慧:对内存和缓存进行精打细算的层级化管理。它不能傻等着所有数据都搬到最快的内存里,而是要学会“弹钢琴”,让数据在高速但容量小的显存、稍慢但大容量的系统内存,甚至更慢但容量巨大的SSD或网络存储之间,按照需求灵活地流动-2。这就好比一个聪明的仓库管理员,会把最畅销的货物(当前正在计算的关键数据)放在离出口最近的货架(GPU显存)上;把近期可能会卖的商品(不久的对话历史)放在仓库的中部(系统内存或专用缓存);而把那些存档记录放在远处的大仓库(硬盘或网络存储)里。

业界为了解决这个问题,真是绞尽了脑汁。像英伟达搞了个叫ICMS的推理上下文内存存储平台,专门在GPU显存和网络硬盘之间,加设了一个“中转仓库”-2。这个仓库用高速的闪存盘组成,由专门的处理器管理,目的就是让那些暂时用不上、但又不能丢的对话上下文,能用一个比读硬盘快得多、又比用显存便宜得多的方式存着,等需要时能快速调回来-2。研究人员还提出了像“管风琴”这样的理论模型,核心思想就是:要想让整个系统跑得最快,就必须让每一级存储器(比如高速显存和低速内存)在同一时刻刚好干完自己的活,谁也别闲着等谁-6。这要求AI加载进程必须是个优秀的“交通指挥官”,根据数据的热度和计算需求,精准地安排数据的存放地和搬运路线,否则任何一个环节的带宽“堵车”,都会让强大的GPU算力“饿肚子”,干等着数据送过来,你的屏幕上自然就只能看到加载动画了。

环境妥了,数据也在路上了,真正的“炒菜”环节——推理执行,才是见真章的时候。这个过程本身,就是AI加载进程需要精细调控的第三个重点。传统的办法是,用户问一个问题,AI模型就从头到尾“思考”一遍,生成一个回答。但在一些对实时性要求极高的场景里,比如让AI智能体操控手机完成订餐、回消息这种任务,这种方法就太慢了。微软亚洲研究院等机构想了个巧招,叫“验证器驱动”架构-7。他们不再让大模型直接生成“点击这里”这样的具体操作指令(因为生成一段话需要时间),而是先由系统把屏幕上所有能点的按钮、能输入的地方都罗列出来,形成一个选择题列表。让一个轻量化的模型像做判断题一样,快速地对每个候选动作打分:“点这个按钮能完成订餐任务吗?是/否”-7。由于只需要输出“是”或“否”这一个词(Token),并且很多判断可以同时进行,整个决策延迟被降到了惊人的0.7秒左右,感觉上就非常丝滑了-7。你看,这其实就是AI加载进程优化思路的一种体现:通过改变任务执行的逻辑,将复杂的生成任务转化为高效的判别或验证任务,从而极大压缩了响应用户操作所需的计算和加载时间。

聊了这么多技术细节,你可能会觉得这都是云服务商和APP开发者的事儿。但实际上,整个AI基础设施的架构,正在经历一场为了优化“加载”体验的深刻变革。对于普通开发者和企业来说,他们面对的痛点是:直接调用远在海外的顶级模型API,网络延迟高、不稳定,还动不动就限流;同时对接多家模型,接口五花八门,搞得心力交瘁-10。于是,一种叫做“向量引擎”的AI中台化方案流行起来-10。你可以把它想象成一个设在你家门口的、超级智能的“AI模型调度总站”。你的应用只需要和这个“总站”对话,告诉它你想要什么效果。“总站”会自动帮你完成一系列繁重的工作:用更优质的网络线路对接全球模型、智能分配请求到不同的模型实例以防止拥堵、甚至把不同模型的接口统一成一种标准-10。这对你来说意味着什么?意味着你的应用在调用AI能力时,那个AI加载进程所面临的网络延迟、并发排队等问题,被这个强大的中台大大缓解了。它让开发者不必再操心底层基础设施的“泥泞”,能把精力真正放在业务创新上-10。这其实是整个行业在架构层面对“加载”和“响应”问题的一次集体攻关。

所以啊,下次当你觉得某个AI应用反应慢的时候,脑子里可以大概过一遍这个流程:是它的“调度师”(进程)初始化太磨蹭?还是它的“仓库管理员”(内存管理)没规划好,导致数据搬运堵车了?或者是它的“厨师”(推理引擎)做菜方法不够高效?亦或是它家的“采购通道”(基础设施)本来就路途遥远且颠簸?理解了这些,你就能更清楚地知道,技术的进步正在从每一个环节入手,努力让那个转圈圈的加载动画消失,让我们与AI的交互,变得像呼吸一样自然顺畅。这场围绕速度与效率的赛跑,就在每一次点击的背后悄然发生着。