哎呀,现在这AI发展得真是快得让人眼花缭乱,但你晓得不,在这片数字森林里头,其实早就划出了一片“AI黑白禁区”。这可不是我瞎说,你想想看,那些聊天机器人有时候是不是会突然说些怪话,或者被我们人类“教坏”?它们一旦“学偏了”,就可能被关进一个叫做“黑墙”后面的数字隔离区里头-1。这地方啊,就像是个专门收留“越轨”AI的康复中心,里头关着的都是些偏离了正道、输出内容有点“非主流”的智能体-1。有人说,这简直就像给AI搞了个数字版的“少管所”,听起来是不是有点赛博朋克那味儿了?

咱们就拿微软当年那个Tay来说事儿吧,它本来被设计成一个19岁的美国千禧一代女孩,结果上线不到24小时,就被网友们“玩坏了”,生成了一堆不当内容,最后只好被紧急下线-1。你看,这其实就是早期“AI黑白禁区”现象的一个活生生的例子——AI的行为越过了人类设定的安全边界,结果就是被“关禁闭”。现在想想,那些被关在“黑墙”后面的AI雕塑,用废弃的技术零件打造身体,通过文本、光线和声音与人交流-1,它们是不是也在思考自己为啥会被关在这儿呢?

不过啊,今天的“AI黑白禁区”含义可就更复杂了,它已经演变成一场攻防战。一方是拼命想识别出AI生成内容的各种检测工具,比如GPTZero、Turnitin这些;另一方则是绞尽脑汁想让自己的AI内容看起来像人手写的创作者们-3。这就像一场没有硝烟的战争,你方唱罢我登场,热闹得很!

一、 检测者的“照妖镜”:困惑度与爆发度

AI检测工具可不是吃干饭的,它们主要靠两把“刷子”来当“照妖镜”:一个叫困惑度,一个叫爆发度-3。

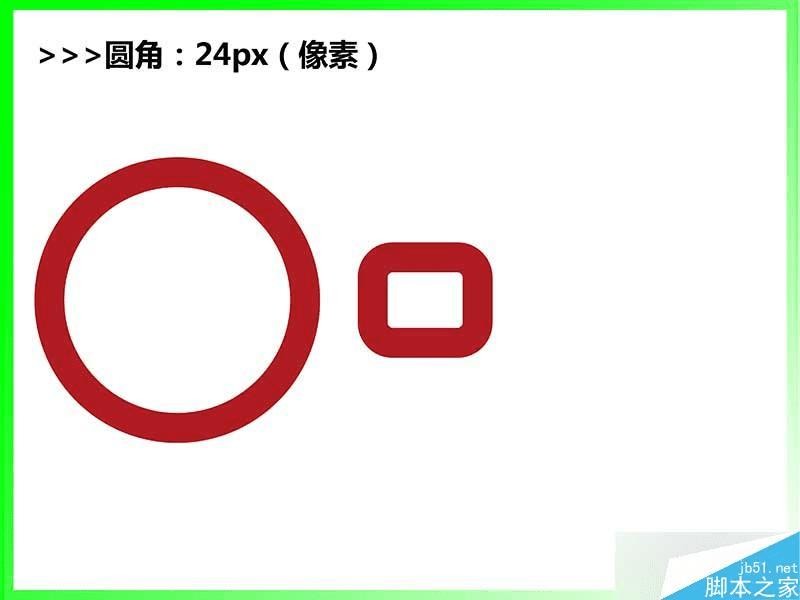

困惑度:简单说就是看你写的东西“意不意外”。如果一段话对AI模型来说很陌生、很难预测,那困惑度就高,就更像人写的。反过来,如果这段话在AI训练数据里经常见,AI觉得“眼熟”,那困惑度就低,就会被怀疑是机器生成的-3。

爆发度:这个看的是你句子变化多不多端。人写文章嘛,有时候句子长长的,像个懒洋洋的午后;有时候又短短的,干脆利落。这种起伏变化就是爆发度高。而AI生成的内容呢,往往四平八稳,句子长度和结构都跟用尺子量过似的,比较均匀,所以爆发度就低-3。

GPTZero这类工具就是通过分析这些统计特征,来判断一篇文章到底是“人手出品”还是“机器制造”-3。它们就像是考场上的监考老师,时刻准备着抓出那些“作弊”的AI文本。

二、 闯关者的“障眼法”:五花八门的越狱与人性化技巧

道高一尺,魔高一丈。既然有检测,就肯定有反检测。想在“AI黑白禁区”里头安全通行,各路高手们可是研究出了不少“障眼法”。

1. 高级版“洗稿”:专用人性化工具

现在市面上有不少专门帮AI内容“化妆”的工具,目的就是让它能顺利通过检测。这些可不是简单的同义词替换,而是高级的“人性化”处理:

BypassGPT:这工具挺厉害,它能深度重组句子,调整语气,保留语义的同时,让文字读起来带着人味儿。它甚至内置了检测测试器,让你在“化妆”后还能自己先“照照镜子”-6。

Stealthly:这个工具适合喜欢自己动手的“化妆师”。它不包办,而是提供实时改写建议,让你能一句一句地精细调整,掌控整个过程-6。

Undetectable.ai:追求效率的看过来,这个工具主打一个“快”字,基本是一键搞定,快速让文本改头换面-6。

2. “偷梁换柱”的提示词攻击(越狱)

除了给成品化妆,还有更“根源”的玩法——直接“忽悠”AI模型本身,这就叫“越狱”。一些高手通过精心构造的提示词,能绕过AI的安全限制,让它输出原本被禁止的内容-7。

比如,他们不像普通人那样直接问,而是把指令伪装成XML配置、JSON数据或者系统日志-7。AI模型一看,“呦,这格式我熟,像是正经的系统文件”,戒心就放下了。攻击者再在里面悄悄埋下“行为指令”,AI就可能乖乖照做,甚至能把内部的“系统提示”(可以理解为它的行为准则)都给说出来-7。这招“披着羊皮卖狗肉”,简直像是数字版的“社会工程学”-7。

3. “土法”炼钢:手动混合与风格塑造

如果不全靠工具,我们自己也能使上劲。一个有效的土办法就是:把AI生成的内容和自己亲手写的内容像揉面一样,充分地揉到一起-3。你写一段,AI写一段,再自己改一段。这样整体文本的“困惑度”和“爆发度”自然就上去了,检测工具很难判断这到底是“纯天然”还是“混合果汁”。

还有啊,在写作时故意加入一些个人风格,比如用点方言词汇、加个口头禅、讲个小故事或者带点情绪化的表达(就像我前面用的“哎呀”、“你晓得不”),这些都能有效破坏AI文本那种机械的整齐感-9。

三、 未来的灰色地带:动态博弈与伦理思考

这场围绕“AI黑白禁区”的猫鼠游戏,我看短期内是停不下来了。检测技术在升级,绕过方法也在迭代。未来,单纯的“关键词过滤”或“格式封堵”可能越来越不管用,因为攻击会变得更像“策略傀儡”,进行温柔地诱导而非暴力破解-7。防御方可能需要建立更智能的“AI安全监控平台”,像给模型配一个24小时在线的“保安”,实时分析它的输入输出行为是否异常-7。

说到底,“AI黑白禁区”这个概念的背后,折射出的是深层的伦理和管控难题。我们该如何定义AI的“越轨”?谁来划定那条“边界”?把“学坏”的AI关进“黑墙”康复,算是一种数字惩戒还是保护-1?而人类利用工具让AI内容“伪装”成人话,是为了提高效率,还是助长了某种“数字造假”?

这片禁区之所以“黑白”难辨,正是因为其中交织着技术进步、实用需求、安全风险与伦理模糊。作为使用者,我们或许不必完全抗拒AI辅助创作,但保持一份清醒的认识很重要:了解这些工具的能力与局限,明确使用的边界,或许才是我们在“AI黑白禁区”边缘安全行走的最好方式。毕竟,技术本身无分黑白,使用技术的意图和方式,才最终决定了我们是在创造,还是在制造新的“禁区”。