哎,你最近有没有接到那种特别“真”的客服电话?声音和真人一模一样,语气、停顿都挑不出毛病,结果挂掉电话才回过味来——那不会是AI吧?不是我大惊小怪,现在这事儿可真不算新鲜了。一份来自英国伦敦玛丽女王大学的最新研究,直接给大伙儿提了个醒:当下最先进的AI声音模型生成的“克隆语音”,其逼真程度已经和真人录音不相上下了,普通人根本分不出来-2。甚至有些AI生成的声音,在“听起来靠不靠谱”这个评价上,得分比真人录音还高-2。

这技术听起来酷,但细想一下,是不是后脊梁有点发凉?这意味着啥?意味着诈骗电话可能用地道的家乡话跟你套近乎,意味着一段你从未说过的言论可能以你的声音传遍网络。技术从来都是双刃剑,今天咱们就来好好唠唠,这已经“成精”了的AI声音模型,到底到了哪一步,它又将把我们的世界带向何方。

技术心脏:从“机械复读”到“有感情的方言专家”

早期的语音合成,那声音一听就是“机器人”,一个字一个字往外蹦,毫无感情可言。但现在,游戏规则彻底变了。现在的AI声音模型,核心追求是“自然交互”,目标是让你感觉就是在和真人聊天。

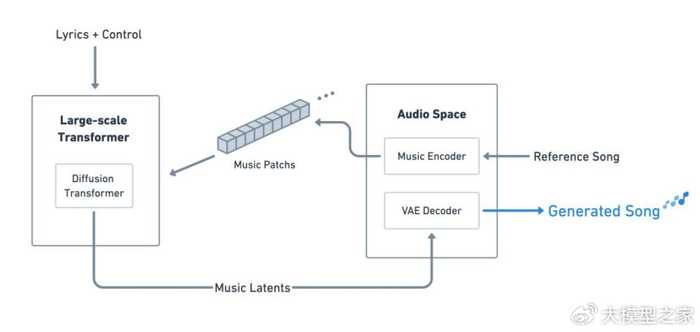

这背后是一套复杂的技术交响乐。一个理想的实时对话AI系统,至少需要三个核心部件协同工作-6:

“快思”模型:这是一个小巧敏捷的模型,它的任务是在用户话音刚落时,就立刻给出一个初步的回应(比如一个语气词“嗯…”),让对话不会有尴尬的停顿,保持流畅感-6。

“慢想”大模型:在“快思”模型稳住场子的同时,背后更强大的主语言模型才开始深度处理用户的完整语句,生成真正有内容、有逻辑的回复文本-6。

“ incremental”(增量式)语音合成器:这是实现“边想边说”感觉的关键。它不需要等大模型把一整段话都写完,而是像流水线一样,大模型写出几个词,它就立刻合成这几个词的语音播放出来,从而实现了极低的响应延迟和更自然的对话节奏-6。

光有速度还不够,声音还得有“灵魂”——也就是情感和个性。这才是目前技术比拼的白热化战场。以开源的EmotiVoice项目为例,它通过“解耦式表示学习”,把一段语音像拆积木一样拆成三个独立的部分:内容(说的是什么)、音色(谁的声音)和情感(用什么情绪说)-7。这意味着,你可以轻松地让一个声音用开心的语气说一段话,或者用愤怒的语气说另一段,而无需重新训练模型-7。

更绝的是对方言的支持。阿里最新的“通义百聆”模型宣称,仅凭3秒录音,就能让声音无缝切换中文、粤语、日语、英语等9种语言及18种方言,还能带上对应的情绪-3。EmotiVoice在实测中也展示了对粤语和四川话的合成能力,虽然部分词汇和情感表达还有优化空间,但已足以让人惊叹-7。这对于需要覆盖广大方言区的客服、内容创作、教育等领域,无疑是巨大的福音。

行业混战:巨头平台与垂直专家的角力

技术很炫酷,但落到商业应用上,各家打法截然不同,选择适合自己需求的平台成了关键。目前的战场,大致可以分为两大阵营:

一类是“巨无霸”生态型平台,比如谷歌的Vertex AI和OpenAI。它们的王牌是“集成”与“多模态”。以谷歌为例,它的语音模型“Chirp”支持超过125种语言,优势在于长尾和小语种-5。更重要的是,它不仅仅是个语音转文本的工具,更是接入Gemini多模态大模型的入口。你可以实时分析通话中的情绪、意图,并触发其他行动,所有数据都在谷歌的生态内流转-5。OpenAI则在努力提升对话的“氛围感”,其模型被评价为能更自然地处理“嗯嗯啊啊”之类的语气词,让交互更像真人-5。

另一类则是“手术刀”式的垂直专家,它们不在大而全上竞争,而是在某个单点上做到极致:

Deepgram:专攻“听”的环节,即语音转文字。它的架构针对低延迟和高吞吐量做了极致优化,在高并发、需要实时字幕或语音指令处理的场景下,速度和成本优势明显-1-5。

AssemblyAI:在“听懂”上下功夫。它能在转录的同时,直接完成内容摘要、敏感信息打码、话题提取等分析工作,省去了你再把文本导入其他AI分析工具的步骤-5。

ElevenLabs / Async:聚焦于“说”的艺术。它们主打高品质、富有表现力的语音合成和声音克隆,目标是生成足以乱真、可用于影视、游戏、有声书等专业领域的声音-1。

还有像Dasha.ai这样的“交钥匙”方案提供商。它解决的是一个更上层的问题:就算你有最好的“听觉”(STT)和“大脑”(LLM)和“嗓音”(TTS),如何把它们无缝组装起来,实现像人类一样自然的轮流说话、实时打断(比如用户一说“等等”,AI能立刻停下)?这需要复杂的对话管理和状态维护能力,而Dasha提供的正是这样一个专为实时语音对话优化的运行时环境-5。

对于普通开发者和企业来说,选择哪条路,完全看你的需求。要构建一个覆盖全球多语言的复杂智能客服,可能离不开谷歌或微软的生态。但如果只是需要一个超快超准的会议转录工具,Deepgram这类专家显然是更经济高效的选择。

现实挑战:安全隐忧与“反克隆”攻防战

技术狂奔的同时,阴影也在迅速拉长。只用几分钟录音就能完美克隆一个人声音的技术-2,已经成为社会工程学攻击的“核武器”。合成语音诈骗的案例在全球范围内已不鲜见,这对个人隐私、金融安全乃至社会信任都构成了严峻挑战。

魔高一尺,道高一丈。针对深度伪造语音的攻防战已经打响,并且主要沿着两个方向展开:

方向一:被动检测,即“鉴伪”。研究人员正在开发各种检测工具,试图从AI生成的语音中找出人耳难以察觉的细微破绽。例如,百度等机构在ESDD 2026挑战赛中提出的EnvSSLAM-FFN方法,专注于检测伪造的环境音和语音,即使在面对未知的AI生成工具时,也取得了很高的检测准确率-4。这就像给音频世界建立了一套“测谎仪”。

方向二:主动防御,即“防伪”。这思路更超前——与其事后鉴别,不如提前让声音无法被有效克隆。一项名为 “VocalCrypt” 的技术就是代表。它的原理是在原始音频中,嵌入一种人耳完全听不见、但会严重干扰AI克隆模型的“伪音色”信息-9。这就好比给你的声音加上了一道只有AI才会“撞上”的隐形电子栅栏,从源头上保护你的声纹不被盗用。相比传统的音频水印(主要用于事后追踪),这种主动防御方法成本更低,也更具可行性-9。

未来已来:我们该如何与“仿生之声”共处?

从能说会道、带方言情绪的AI客服,到可能威胁我们财产安全的深度伪造,AI声音模型带来的是一幅复杂的未来图景。它绝非简单的“好”或“坏”可以概括。

对于创作者而言,这是一个黄金时代。开源工具如GPT-SoVITS给了技术极客完全的自由度-8,而像Lipvoice这样基于高效模型(如IndexTTS 2)的商业工具,则以极低的成本提供了大量额度的清晰、稳定的旁白生成能力,极大降低了音频内容的生产门槛-8。

但对于社会整体,我们必须建立新的规则和“免疫系统”。这包括:

技术层面:持续发展并普及更强大的深度伪造检测和主动防御工具。

法律与伦理层面:尽快立法明确声音权益的归属,规范声音克隆技术的使用边界,对恶意滥用行为进行严厉打击。

公众意识层面:我们需要一场全民科普,让每个人都知道“耳听为虚”在数字时代有了新的含义,对涉及金钱交易、敏感信息的语音沟通,保持更高的警惕性,养成二次确认的习惯。

AI声音的进化列车已经离站,并且正在不断加速。它驶向的,是一个交互更便捷、创作更自由的世界,但沿途也布满了欺诈与侵权的陷阱。作为乘客,我们无法也不能要求列车停下,唯一能做的,是系好“安全意识”这条安全带,并共同握好“法律与伦理”这个方向盘。只有这样,我们才能确保这趟旅程,最终抵达的是造福人类的下一站,而不是混乱的深渊。