哎呀,说到处理那些复杂的文档,你是不是也头疼过?特别是那种表格套表格、图文混排的PDF或者扫描件,想要把里面的文字信息规规矩矩地提取出来,简直像在玩高难度拼图。这时候,就该看看现在的AI是怎么大显神通滴。今天咱们就唠唠,AI怎么分割网格文字,把这背后听起来高大上的技术,用大白话给你讲明白咯。

从“乱麻”到“网格”:给文档拍张结构化“CT”

首先你得明白,AI眼里的文档,尤其是扫描件或复杂排版的PDF,最开始就是一堆像素,文字在哪里、哪几个字是一伙的、谁是谁的标题,它统统不知道。传统的OCR(光学字符识别)有时候就跟眼神不好似的,只会按顺序读字,遇到分栏、表格就全乱套了,读出来的东西根本没法看-4。

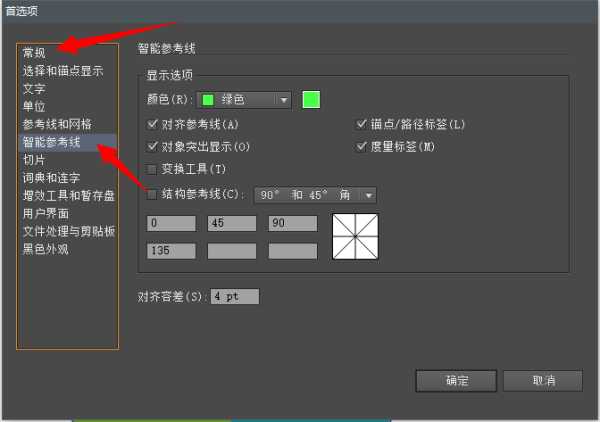

所以,关键的第一步,是让AI能“看懂”文档的版面结构。这就好比给人拍CT,一层层看清骨骼和器官。AI做的叫做“版面分析”,它的任务就是把整张文档图像,按照人类的阅读逻辑,分割成不同的功能区域-4。比如,这里是文章大标题,那边是段落正文,左边有个表格,右下角还有个印章-4。一些先进的技术,像ViBERTgrid,走得更远。它创造了一种“基于网格的文档表示法”,把文字信息和它在页面上的二维布局位置(比如坐标)一起,编码成一个类似棋盘格的特征图-1。你可以想象成,不仅识别出了棋子(文字),还在棋盘(页面)上给每个棋子都标明了精确位置和它属于哪一方阵。这样一来,文档的文本内容和空间布局信息就被同时、同维度地捕捉到了,为后续的精确分割和提取打下了超级结实的基础-1-3。

“分而治之”的智慧:表格、标题与段落各就各位

看清了结构,接下来就是“动手”分割了。这里的“分割”可不是简单的一刀切,而是充满智慧的“分治策略”。不同的内容类型,AI用的方法也完全不同,这就叫“对症下药”。

最让人头疼的表格,就是典型例子。对于边框清晰的有线表,AI会动用像语义分割网络这样的技术,像侦探一样找出所有横线竖线,重建出网格结构,准确率能非常高-7。但现实中大量表格是无线表,或者边框残缺不全。对付它们,就得结合序列预测、上下文建模这些手段,去推理和预测哪些文字应该属于同一个单元格,哪些单元格又属于同一行同一列,硬生生把逻辑结构给“脑补”出来-7。这个过程,就深刻体现了AI怎么分割网格文字的精髓——它不仅仅是“看”线,更是“理解”内容之间的语义关联和空间对齐关系。

除了表格,对于标题、段落、列表、图片标题等整整十九种之多的区域类型,现在的版面分析模型都能进行识别和分类-4。这样一来,AI就能像熟练的编辑一样,把一锅粥似的文档,整理成结构清晰的素材库。这个过程,离不开深度学习模型,比如全卷积神经网络(FCN)和图神经网络(GNN) 的助力,它们帮助AI综合考量文本的几何位置、视觉特征和语义,做出更准确的判断-8。

超越“物理切割”:进入语义分块的新层次

前面说的版面分析,主要解决的是“物理层面”的分割,确保机器找到正确的文字块。但对于像构建知识库、开发智能客服(RAG系统)这类更高阶的应用,光这样还不够。我们还需要在理解内容的基础上,进行“逻辑层面”的、符合语义的切分,这就是“分块”。

传统分块方法很简单粗暴,要么按固定字数切(比如每300字一刀),要么按标点换行符递归地切-2。这些方法快是快,但毛病很大:经常把一句完整的话拦腰斩断,或者把两个不相关的话题硬塞进一个块里,导致后续检索效果大打折扣-6。

于是,更聪明的“语义分块”应运而生。这里有个特别有意思的策略叫“最大-最小语义分块”。它的核心思想就一句话:先理解,后切割-6。具体咋做呢?AI会先把文档里的每一句话都转化成数学向量(这个过程叫“嵌入”),这个向量代表了这句话的深层含义。它像点豆子一样顺序检查句子:它一边盯着当前这个“块”里所有句子含义的最疏远程度(最小相似度),一边判断新句子和这个块里任何句子的最亲密程度(最大相似度)。如果新来的句子和这个块“够亲”,比块里已有的句子之间“最疏远”的关系还要亲,那就让它加入;如果不亲,那就果断从这里开始切一刀,新开一个块-6。你看,这种方法彻底抛弃了死板的字数限制,让分块的边界严格跟随文章意义本身的起伏而变化,产生的文本块更自然,更像人阅读时心里的那种段落感-6。

更进一步,还有所谓的“智能体式分块”,它把切割文本这件事本身,也交给了一个AI小助手(智能体)来动态决策。这个小助手能根据文档的内容类型、甚至是你后续要问的问题的意图,来灵活选择最合适的分块策略和大小,并且智能地在块与块之间设置一些内容重叠,就像电影转场一样,确保关键上下文不丢失-9。这可以说是把 AI怎么分割网格文字 这件事,从一项静态的预处理工作,升级成了一个动态的、与最终任务目标协同的智能过程。

实战与展望:效率提升背后的挑战

这些技术可不是纸上谈兵,它们已经实实在在改变了很多行业的工作流。在金融领域,处理复杂的财务报表和审计报告;在政务领域,数字化海量的档案文件;甚至在文化保护领域,用于古籍、报刊的数字化存档-8。通过AI分割和提取,效率的提升是几十倍甚至上百倍的,而且大大降低了人工录入和整理中难以避免的错误。

不过,实话实说,这条路也并非一片坦途。面对极度复杂、扭曲变形或排版天马行空的文档,AI仍然会力不从心-8。而且,语义分块虽然好,但如何平衡“信息纯度”和“上下文完整性”,一直是个难题。块切得太细,信息检索准,但可能失去必要背景;块太大,又容易掺入噪音-6。像跨页表格的自动拼接、手写体与印刷体的混合识别等,依然是技术攻坚的前沿-7。

总的来说,从让AI“看见”网格化的文字布局,到引导它“理解”并按照语义进行智能分割,我们正在教会机器用一种更接近人类的方式来处理信息。这个过程,充满了将复杂问题层层拆解、分而治之的智慧。下一次当你看到AI瞬间解析出一份复杂合同的所有条款和表格时,你大概就能知道,这背后是一场从物理结构到语义逻辑的、层层递进的精密手术。而这场手术的核心目标,始终是让沉睡在杂乱文档中的信息,变得规整、清晰、随时可用。