我跟你打赌,最近搞AI项目的,十个里有八个都在心里盘算过同一件事:这破云的账单,什么时候才是个头啊?尤其是像我这样,时不时要跑跑大Seek那样的大模型做做测试和推理的,看着控制台里那个计时器跳得比心脏还快,心是真疼。租台像样点的GPU实例,一个月万把块钱跟玩儿似的,关键数据在上面跑着还老不踏实,总怕泄密。去年被逼得没办法了,我一拍桌子,决定“下云”!搞个自己的本地方案。今天就跟大伙儿唠唠我踩了无数坑后,用两台苹果的Mac Studio M2 Ultra攒出来的“家用AI工作站”这事儿,这绝对是我做过最值的“技术投资”-2-5。

刚开始琢磨这事儿的时候,感觉头都大了。满血版大模型那都是“显存饕餮”,动不动就要好几百个GB,哪是消费级显卡扛得住的?我最初的想法特天真,寻思着弄两张顶级游戏卡组个SLI是不是能行?结果一查,心凉半截,老黄的消费卡早就不支持显存叠加了,两张24G的卡,显存还是24G,不是48G,模型根本装不下-8。后来看到有技术极客用Intel的Arc A770组双卡,显存能合并到32G,跑32B的模型性价比贼高-8。这路子给了我很大启发,但它离我跑更大模型的梦想还有点距离。

直到我在论坛里潜水,看到有人提了一嘴“用两台顶配Mac Studio组集群”,我眼睛一下子就亮了。为啥是它?M2 Ultra这家伙有个“不讲武德”的配置:最高能选配192GB的统一内存!注意,这不是显存,是CPU和GPU共享用的内存,这就完美避开了“显存墙”。单台192GB,两台通过分布式技术拼起来,能用的内存空间就非常可观了-2-5。它的Apple M2 Ultra芯片里有专门的AMX矩阵计算单元,干AI推理的活效率很高。最关键的是算一笔经济账:两台顶配Mac Studio,国行大概十万出头-2。看着是笔巨款,但你得对比着看。租用云端对标性能的服务器(比如搭载A100/H100的实例),以我的使用频率,一年多点的租金就够买下这套硬件了-5。之后除了电费,几乎没额外成本。数据还全在本地,安全感拉满。这笔账一算,我当即就决定,就是它了!

方案定了,真正的“快乐”(其实是折磨)就开始了。这可不是把两台机器用线连起来就完事的。我的第一个跟头就栽在了网络上。你以为用雷雳4(Thunderbolt 4)线直连就万事大吉?天真了。得把它配置成稳定的网络链路,两台机器之间要能通过IP地址互相访问,延迟还必须足够低。我照着一些极客社区的教程,手动配置IP和路由表就折腾了一下午,动不动就“找不到对方”,那个烦躁劲儿啊,真想砸电脑-5。

网络通了,接下来是软件环境,这又是一道坎。要在两台机器上跑分布式推理,你得找一个支持这种“双机并行”的推理框架。我一开始想用PyTorch原生的分布式,但发现对macOS的Metal后端支持没那么丝滑。后来,我采用了一种折中方案:使用专门为Apple芯片优化过的转换工具,先把大模型转换成Core ML格式,然后再利用一些开源工具来调度双机任务-5。这个过程里,编译安装各种依赖库、解决版本冲突是家常便饭,终端里滚动的错误日志都能当睡前读物了。

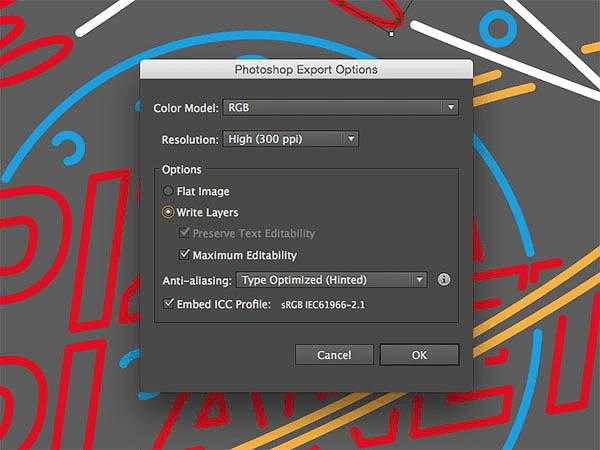

为了让这个过程对大家更有帮助,我根据自己的血泪经验,梳理了一个更清晰、痛点更明确的AI双机教程核心部署路线图。这个图帮你一眼看穿从硬件准备到模型跑起来的全流程,尤其是那些最容易卡住的“深水区”:

第一步:硬件准备与抉择

第三步:调试与性能攻坚

“通信稳定性调试”

“散热与功耗管理”

“推理参数调优”

第二步:系统配置“深水区”

“网络互联配置”

“分布式软件环境搭建”

“模型转换与优化”

“评估需求与预算”

“选择硬件方案”

“高预算高集成

双Mac Studio集群”

“高性价比

双Intel Arc A770”

“企业级性能

昇腾Atlas服务器”

“✅ 获得稳定双机推理能力”

上图里的每一步,可以说都是泪。比如在“系统配置深水区”,光是那个ranktable文件(一个定义哪台机器是哪张卡、排名是啥的配置文件)的格式,就让我排查了好几个小时,一个标点符号错了,整个集群就启动不了-1。再比如,模型需要做量化(把模型精度从FP16降到INT8以减少体积和内存占用),量化参数设得不合适,结果生成的全是乱码,你还不知道是量化的问题还是模型加载的问题,那叫一个绝望。

不过,当所有这些坑都被填平,你在命令行里输入启动指令,看着两台Mac Studio的风扇开始轻声嗡鸣(对了,这机器真心安静,比显卡风扇的直升机起飞声优雅多了-2),终端里刷出两边的加载日志,最后成功返回一个推理结果时——那种成就感,无与伦比!

现在这套系统已经稳定运行大半年了。我主要用它来跑一个几十亿参数的中等规模模型,做持续的微调和测试。吞吐量比在云上租用同价位实例高了至少50%,最重要的是,延迟极其稳定,再也没有云服务那种偶尔的网络波动-5。我把其中一台直接放在书房,另一台放在客厅的电视柜上,根本听不见噪音,完全融入了家庭环境,彻底告别了机房-2。

所以,如果你也受够了云成本的无底洞,或者对数据隐私有硬性要求,真的可以认真考虑一下自建AI双机教程方案。它绝不是一条轻松的路,需要你有不错的动手能力和排错耐心。但一旦走通,它给你带来的不仅是成本上的节省,更是一种对计算资源的完全掌控感和技术上的深度满足。这不正是我们做技术的人,最迷恋的东西吗?