你肯定遇到过这种事儿,用那些顶聪明的AI生成张图片或者剪段视频,乍一看,嚯,真像那么回事儿!可只要稍微定睛一瞧,或者想让它按你的意思动一动,毛病就全出来了——说好让角色转身,结果转回来连五官都挪了地方;想精准替换照片里某个小物件,AI却把周围弄得一团模糊-1。这感觉,就像你跟一个近视一千度还没戴眼镜的朋友比划半天,他最后给你来了句:“啊?啥?” 急得人直跺脚。

过去很长一段时间,很多AI视觉工具都困在这种“电子近视”里。它们像个认真的但死板的画匠,吭哧吭哧计算着每个像素点的颜色和位置,靠概率“蒙”出一张看起来对的画面-1。这种路子,对付静态的、固定的任务还行,可一旦需要它理解画面里东西是啥、之间啥关系、动了会怎样,它就抓瞎了。因为它脑子里没有“世界”,只有一堆像素点的排列组合,当然没法理解“把左边那个红杯子递给我”这种简单指令-2。

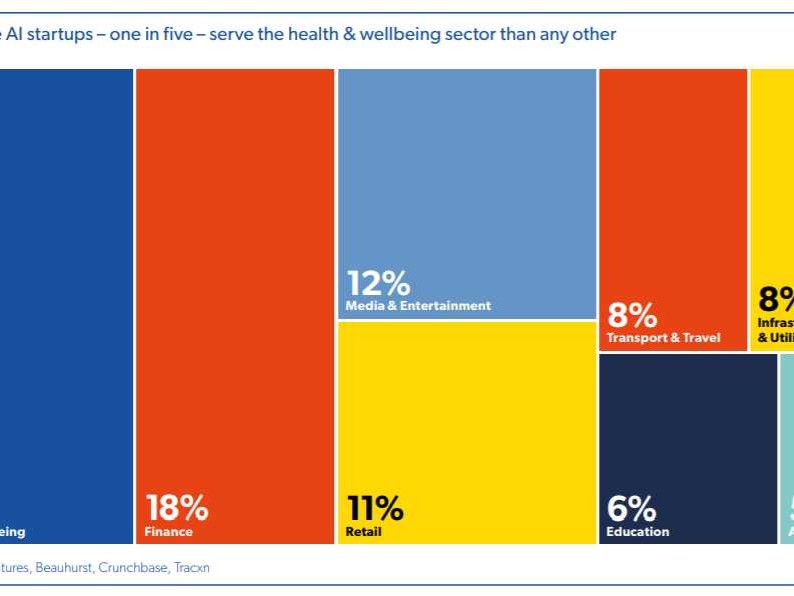

所以,现在咱们讨论ai像素结果,早就不再是单纯聊“画面清不清晰、颜色艳不艳丽”了。这场竞赛的核心,已经升维到了AI的“理解力”层面。大家拼的是,谁能从那一大片像素的“数字海洋”里,真正打捞出有意义的“实物”,并理解它们之间的物理和逻辑关系-5。这就像从只会临摹字帖,到真正读懂文章在说啥,是一次根本性的跨越。

要治这“电子近视”,光给“眼睛”(传感器)升级还不够,关键得换“脑子”。最新的技术正在从根儿上改变AI处理视觉信息的方式。比方说,有些研究者就让AI模型学会了“眼脑并用”,像咱们人一样,先瞥一眼全局,发现疑问再聚焦到细节上去看-7。比如问它“咖啡杯上写的啥牌子”,它不会傻乎乎地对着整张图猜,而是会先锁定桌面区域,再把杯身局部放大,像用放大镜一样仔细扫描那些像素点,最后读出logo-7。这种在像素空间里直接进行“显微镜式”观察和推理的能力,让AI的“眼力见儿”精细了不止一个档次。

更绝的是给AI装上“情景记忆”。你肯定烦透了那种让AI生成个连续画面,结果它“金鱼记忆”,转过镜头就忘了刚才墙是啥样的窘境。现在一些先进的世界模型,就致力于在内部构建一个稳定的、3D的“心理空间”-1。简单说,它生成的不再是一帧帧独立的平面画,而是一个可以走进去、从不同角度观察的“虚拟雕塑”。这样无论你怎么变换视角,房间的格局、物体的位置都是稳固的,彻底告别了“转身即忘”的尴尬-1。这种对空间持久性的把握,才是真正“理解”世界的基础,也让ai像素结果第一次有了“可信的时空感”。

这些“治近视”的良方,一落到实际生活里,那效率提升可就不是一星半点了。就拿商业摄影来说,传统的精修流程,从选片到调色、磨皮、抠图,一套下来折腾几天是常事。但现在有了集成先进像素级理解能力的AI工具,情况就完全不同了。它能像经验丰富的修图师一样,瞬间理解照片的构成:哪部分是发丝需要根根分明地抠出来,哪部分是皮肤需要柔化,背景的光影该怎么自然融合-4。有工具已经能把过去3天的工作量,压缩到惊人的3分钟内完成,效率提升上千倍,这可不是简单的“加速”,而是对工作流的彻底重塑-4。设计师和营销人员也因此被解放出来,以前要反复沟通修改的细节,比如“把盔甲从红色改成深紫色,再把背景调暗些”,现在只需要对着AI说人话就能瞬间搞定,快速进行A/B测试-9。你看,当ai像素结果具备了深刻的语义理解能力,它就从“负担”变成了释放创意的“弹簧门”。

所以啊,下次当你惊叹于一段AI生成的逼真视频,或者用一句话就P好了张复杂图片时,不妨想想背后发生的事。这早已不是一场关于“像素多少”的军备竞赛,而是一次让机器学会“观看”、进而“理解”我们世界的温柔尝试。从一堆没有生命的数字点阵中,构建出稳定、可信、可交互的视觉叙事,这场摆脱“电子近视”的旅程,才刚刚点亮前路的那盏灯-5。未来的AI,或许真能像一个默契的伙伴,不仅看清你的所指,更能读懂你的未尽之言。