哎呀,说起现在这个AI画图啊,真是让人又爱又恨!你看,随便输入几个词儿,嗖一下就能给你生成一张看起来挺像那么回事儿的图片,这要搁以前,想都不敢想!但是嘞,用久了你就发现一个挺恼火的事儿——这AI生成的图片啊,它是个“铁板一块”,你想单独挪动里头的一个小元素,比如把左边的那棵树挪到右边去,或者给中间那个人换个姿势?嘿,没门儿!基本上就是“牵一发而动全身”,一动全图都得跟着变,有时候改完简直面目全非,亲妈都认不出来-2。这就是咱们今天要唠的根儿上问题:ai图片不能置于顶层整理内容,说白喽,就是它们缺乏像Photoshop里那种分图层的、可以灵活编辑的智能结构。

一、 为啥AI画的图都是“一张饼”?技术的老底儿得揭一揭

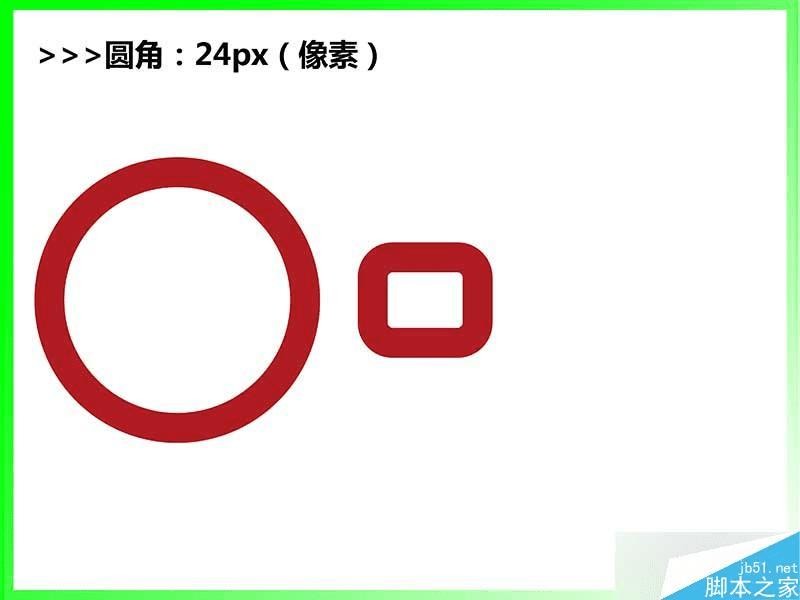

要弄明白这事儿,咱得先扒一扒现在主流AI画画(主要是扩散模型)是咋工作的。你可以把它想象成一个特别有天分但又有点“死心眼儿”的画师。你给他一个描述,比如“山顶有座红房子,房前有棵树,天上有朵云”,他是把这句话当成一个整体来理解的,然后吭哧吭哧给你画出一整张完整的图画。这张画在他脑子里和最终产出上,都是融合在一起的像素集合,房子、树、云彩的边界在语义上是模糊的,并没有被明确地标记为“这是物体A,那是物体B,它们各自独立”-1。

这就导致了一个核心痛点:ai图片不能置于顶层整理内容,其根源在于生成过程本身就是“混合酿造”而非“分层组装”。模型学的是像素之间的统计关联和整体构图,而不是一个可以拆解的、带有逻辑关系的对象树。当你想编辑布局时,比如把房子挪个位置,模型很难从这块已经“和稀泥”的像素里,干净利落地把房子的视觉概念(包括它的颜色、纹理、阴影)单独“抠”出来,再天衣无缝地放到新位置,同时保持其他部分不变-1。结果往往是修补痕迹明显,或者整体风格突变。

这种“扁平思维”在简单场景下还凑合,一旦遇到复杂点的、有多个物体相互遮挡的图,那就更抓瞎了。比如一张图里有好几个人前后重叠,现有的技术很难在边界处清晰地生成每个独立个体,经常糊成一片-6。你想把后面那个人单独拎出来调整?对不起,技术层面目前这还是个老大难。

二、 “动一处则乱全局”:创作中的具体疼点

这种底层限制,给咱们的实际使用带来了不少“憋屈”的体验。我跟你念叨几个场景,你看看是不是也遇见过:

想微调?等于重画! 你生了张宣传图,老板说“左边那个图标放大一点,顺便往中间挪挪”。你要是用传统设计软件,分分钟搞定。但面对AI生图,你这个指令几乎无法直接执行。你只能去改提示词,加上“巨大的、居中的图标”之类的描述,然后祈祷新生成的图其他部分还能保持原样——通常这种祈祷都是白费力气-2。

风格统一是个梦。你想做一个系列海报,主角是同一个卡通形象,只是姿势和背景不同。用AI的话,你每次生成的形象在细节上(比如眼睛大小、衣服皱褶)都会有细微差别,很难保持严格的统一。因为它每次都是从零开始“理解”你的描述并绘制,而不是在一个基准图层上进行变换。

后期合成效率低。很多朋友的想法是:AI生成主要元素,我再手动抠图去排版合成。但这又回到了老路上,而且AI生成的图像边界往往不够清晰理想,抠图本身就很费劲,完全没享受到智能技术该有的便利。

你看,这就引出了ai图片不能置于顶层整理内容的第二个关键痛点:它严重阻碍了迭代式、精细化的创作流程,让AI更像一个一次性的灵感喷射机,而不是一个可以反复打磨作品的合作者。

三、 曙光已现:技术正在尝试“给图像分家”

难道就真没辙了吗?也不是。科研界和业界已经意识到这个“硬伤”,并开始朝着“图层化”、“结构化”的方向猛攻了。这可不止是简单地在生成后加个分割算法,而是试图让AI在生成过程中,就具备理解图像内部结构的能力。

比方说,阿里云推出的Qwen-Image-Layered模型,就在尝试搞一场“图层革命”-2。它的目标是把AI从“画饼师傅”变成“乐高大师”。据说它能对图像进行“语义解耦”,意思是初步识别出图中不同的概念对象(比如人、树、房子),并以一种更分离的方式来处理它们的信息,从而支持一定程度的精准移动、缩放-2。这算是朝着“可置于顶层编辑”迈出的重要一步。

另外,像复旦大学和小红书联合搞的InstanceAssemble技术,则从另一个角度切入-7。它特别强调“布局控制生成”,你不仅可以描述物体是什么,还能用边界框指定它们应该在哪里。模型会努力按照这个精确的布局来生成图像,确保每个物体在语义上和位置上都对得上号-7。这虽然还不是完全自由的后期图层编辑,但为生成之初就获得结构清晰、元素位置可控的图像提供了强大工具,算是从源头上为后续整理打下了更好的基础。

还有的研究在专门攻克“多个重叠物体”的生成难题,通过“边界感知”等技术,让重叠部分的生成更清晰,为将来可能的分离创造条件-6。这些努力都在说明,ai图片不能置于顶层整理内容的现状正在被挑战,下一代AI绘画工具的核心能力,可能就是“可编辑性”。

四、 前方的路:融合、理解与自由编辑

未来的理想状态是啥样呢?咱们可以大胆想象一下:

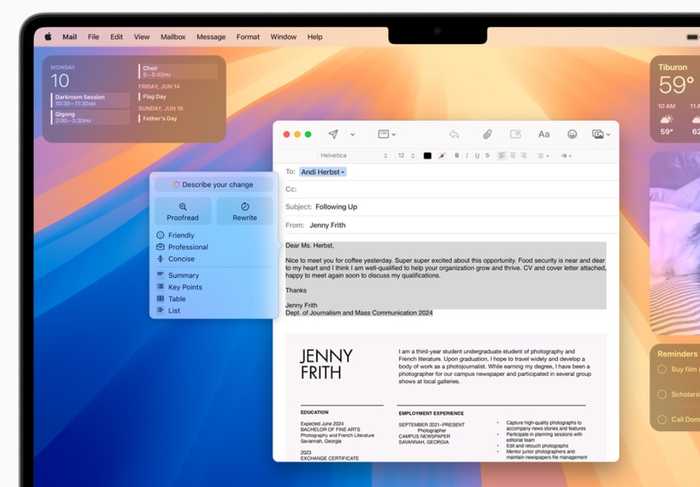

未来的AI图像生成,可能会更像一个“智能PS”。你输入一段描述,它不仅能生成最终图像,还附带生成一个初步的、分好层的PSD文件。每个语义上独立的物体都在自己的图层里,带有透明的背景。你可以随意开关图层、调整图层顺序、对某个图层单独进行缩放、滤镜、微调提示词再生成(而其他图层不变)。

要实现这个梦想,技术得在三方面继续升级:一是更精细的“视觉概念解耦”能力,真正分清哪堆像素属于同一个逻辑实体;二是强大的“一致性保持”技术,确保单独编辑一个元素时,它的视觉特征(如光照、纹理风格)能与整幅图和谐共融-1;三是发展出高效的“局部重生成”模型,只针对选定的图层区域进行扩散生成,而不影响周边区域。

到那时,“ai图片不能置于顶层整理内容”这句话就会成为历史。我们与AI的协作会变得无比顺畅:你可以让AI生成一个基础场景,然后把里面你觉得不满意的角色拖出来,直接对它说“把姿势换成跑步的”,AI便只修改那个图层。你还可以轻松组合不同AI生成作品中的精华部分,创造出无限可能。

现在的AI绘画就像个能喷出完美大理石胚料的机器,但雕刻细节还得靠我们手动笨拙地打磨。而我们期待的,是它能直接给我们一套可以随意组装、修改的标准化构件。这条路虽然还长,但方向已经越来越清晰了。作为用户,咱们就一边用着现有的工具激发灵感,一边等着那个真正“可分层、可编辑”的智能创作时代到来吧!那会儿,咱们的创作效率和精神,准保能再往上蹿一大截子!