你是否也经常被AI领域的各种术语搞得晕头转向?随着技术爆炸式落地,诸如微调、RAG、RM、TTS、ASR之类的“黑话”层出不穷。别担心,今天我将为你掀开这些高深概念的面纱——它们不仅是技术标签,更是你理解AI能力边界、甚至驾驭AI的关键密码。无论你是产品人、运营者还是内容创作者,这篇指南都将帮你构建对AI训练机制的底层认知框架。

作为一名深度浸泡在AI领域的从业者,我每天的工作就是“调教”这些数字大脑。今天,我想邀请你一起走进AI的“核心车间”,抛开那些令人望而生畏的公式和代码,用最直白的人话,把塑造AI能力的五大核心利器给你讲透。阅读这篇长文,我保证,未来你再看到任何AI动态,都将拥有“一眼看穿本质”的底气。

引言:欢迎来到AI的“幕后厨房”嘿,伙伴们!

我们每天都在与AI互动:让它写周报、做策划、甚至生成一张海报。你看到的是它光鲜亮丽、对答如流的一面。但在幕后,我们就像大厨和教练,用各种“烹饪技法”和“训练方法”引导、塑造这些数字大脑,让它变得真正“好用”。

今天,我就来为你展示我们工具箱里最核心的五件“神器”:

微调 (Fine-tuning): 如何将一名“通才”学霸,精准打造成解决你特定问题的顶尖专家。RAG (检索增强生成): 如何为AI装备一个永不过时、随用随查的“超级外接大脑”。RM (奖励模型): 如何教会AI明辨是非对错,让它真正理解并贴合人类的价值观与喜好。TTS (文本转语音): 如何让AI“开口说话”,并拥有堪比真人的情感与表现力。ASR (自动语音识别): 如何让AI精准“听懂”人话,将声音毫秒级转化为可处理的文字。

准备好了吗?系好安全带,我们即刻出发,深入探索这五大神器的奥秘!

第一章:微调 (Fine-tuning) —— 把“通才”打造成“专家”

从零训练一个AI,如同哺育一个婴儿认识世界,需投喂海量数据,耗时耗力,堪称巨头游戏。最终我们得到一个预训练模型(基础模型)。

它就像一位常青藤名校毕业生,知识渊博,能与你侃侃而谈。但若让他立刻起草一份专业的法律合同,他大概率会“翻车”——他懂通用法律概念,却不熟悉你公司的具体条款与行文习惯。

此时,微调(Fine-tuning) 便强势登场。

一个形象的比喻:岗前特训

微调,就是为这位高材生定制的高强度岗前特训。

基础模型 (Pre-trained Model): 那位通才型毕业生,具备出色的学习与理解基础。你的特定任务: 成为你公司的专属法律合同助理。你的专有数据 (Fine-tuning Dataset): 你公司历年积累的合同范本、往来邮件、风控条款——数量不多,但极度精准、专业。微调过程: 不再教他基础语法,而是让他反复研读、学习这些专业材料,深度理解你公司的“行话”与风格。最终结果: 短短时日,他便转型为你业务线上最得力的专业助手,输出内容高度契合你的需求,而其原有的通用能力丝毫无损。

这就是微调的核心:站在巨人肩膀上,用少量高价值数据,让通用模型精准适配你的专属战场。

微调如何运作?

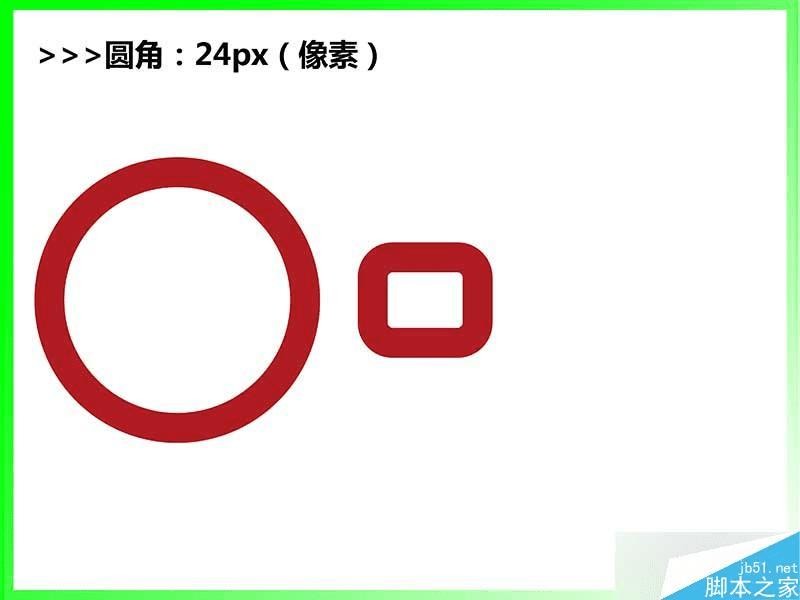

想象AI模型是一个拥有千亿旋钮的超级调音台。预训练设定了“演奏通用音乐”的初始状态。

微调则如下进行:

准备“乐谱”: 准备专有数据集。例如,训练客服AI,就需“用户问句”与“标准答法”的配对数据。加载“调音台”: 载入预训练好的通用模型。演奏与校准: 输入用户问句,模型基于当前“旋钮设置”生成回答。程序将其与“标准答案”对比,计算差异,然后极其精细地反向调整相关旋钮,让输出下次更接近标准。海量重复: 用海量数据反复训练,模型的“旋钮”状态不断被推向任务最优解。专家诞生: 最终,模型被“塑造”为特定领域的专家,面对专业问题,能给出精准回应。

关键在于“微”调。调整幅度极小,模型在获得新技能包的同时,不会遗忘原有能力,如同为游戏安装了一个精良的DLC。

为什么微调不可或缺?

如果说预训练是建设城市的“基础设施”,微调就是在之上建造满足各类需求的“特色建筑”。其价值无可替代:

1. 实现深度专业化与定制化:

行业赋能: 将通用模型转化为精通医学、金融、法律的行家。注入品牌灵魂: 用你公司所有的文案内容微调,让AI的输出风格与你十年老员工别无二致。克隆个人风格: 用你的文章训练,让它帮你续写,文风、用词皆与你本人神似。

2. 极致提升特定任务表现: 对于明确任务,如“财报摘要”,经财报数据微调的模型,其精准度远超通用模型,因为它被训练得“心无旁骛”。

3. 成本与效率的革命: 无需天价从头训练。微调让你以极低成本、在几天内获得专属专家模型,让中小企业也能享受顶尖AI能力。

4. 增强可控与安全: 用“安全、有益”的数据集微调模型,完成对齐(Alignment),为AI设定行为准则,使其输出更可靠、更安全。

微调的挑战

其成功核心在于高质量数据。若训练数据是垃圾,产出的也只能是垃圾。“Garbage in, garbage out”在此体现得淋漓尽致。

小结: 微调是AI从“炫技玩具”迈向“生产利器”的关键一跃。它将AI的通用能力,如激光般聚焦于你的细分领域,是AI产业化应用的基石。

第二章:RAG (检索增强生成) —— 给AI一个“开卷考试”的机会但微调有两大致命短板:

知识时效性: 模型知识止于训练完成时刻,无法获知新信息。“幻觉”问题: 面对未知细节,AI可能凭语言模式“捏造”答案,而非坦诚“不知”。

当问题需要最新信息(如“公司上月新品功能?”)或绝对准确、有据可查(如“员工手册5.2条年假规定?”)时,微调无能为力。

RAG (检索增强生成) 应需而来,完美破局。

一个形象的比喻:开卷考试

想象你(AI模型)要参加“明朝历史”考试。

无RAG(闭卷考): 仅凭记忆作答,偏门问题易出错。

有RAG(开卷考): 考试时,你手边有全套《明史》。流程是:

审题: “郑和船队规模?”检索 (Retrieval): 迅速在史料中找到所有相关段落。生成 (Generation): 基于找到的确切资料,组织语言,给出准确回答。

RAG,即为AI开启“开卷考试”模式。

大模型 (LLM): 聪明的学生,负责理解与组织。知识库 (Knowledge Base): 你的私有文档、最新数据库等。检索器 (Retriever): 超级图书管理员,能光速找到最相关信息。

RAG的精髓:不要求AI记住一切,而是训练它在需要时,精准查找并利用外部知识库。

RAG如何运作?

RAG流程如同精密的流水线:

前期:建立“数字图书馆”

将私有文档(PDF、网页、数据)通过技术转化为AI可理解的“数字坐标”(Embedding),内容相近的文档坐标也接近。这个布满“知识点”的空间即向量数据库,是AI的专属图书馆。

用户提问

用户问:“公司A产品与B产品区别?”

第一步:检索 – 精准找书

将问题也转为“坐标”,在“图书馆”中快速找到坐标最接近的文档片段(如产品白皮书、宣传页)。

第二步:增强 – 打包上下文

将原始问题与检索到的参考片段打包,形成增强提示,例如:“请根据以下信息回答‘A、B产品区别?’:【背景信息1:A产品…】【背景信息2:B产品…】”

第三步:生成 – 开卷作答

将此“增强提示”交给大模型。模型如同看到题目和参考答案要点,只需整合资料,生成通顺、准确的回答,大幅降低“编造”。

为什么RAG至关重要?

知识永不过时: 知识库可随时更新,AI回答永远基于最新资料。强力抑制“幻觉”: 答案源于真实外部文档,而非内部模糊记忆,可信度极大提升。答案可溯源: 可附带答案来源链接,便于核验,对法务、医疗等高信度场景至关重要。低成本、高灵活: 更新知识只需更新知识库,无需重新训练大模型,成本低、速度快。可为不同部门配置不同知识库,灵活切换。

RAG的挑战

成败关键在于检索质量。若第一步检索即出错,后续生成再优秀也无用。构建高质量知识库与设计精准检索器,是RAG系统的生命线。

小结: 微调是“内科手术”,强化AI内在;RAG则是为AI配备“智能眼镜”与“外挂硬盘”,赋予其实时获取并利用外部准确信息的能力。它常是企业应用中最快、最经济的解决方案。

第三章:RM (奖励模型) —— 教会AI“知好歹、辨是非”我们已教会AI专业技能(微调)与查阅资料(RAG)。但更深层的问题是:如何让AI的回答不仅正确,而且“好”?

“好”是主观的,可能意味着:有帮助、无害、诚实、符合人类偏好(如幽默或严肃)。

要教会AI这些复杂、难以规则化的价值观,我们需要一位特殊的“价值观导师”——奖励模型。它本身也是一个AI模型,其职责是给答案打分,是整个基于人类反馈的强化学习流程的核心裁判。

一个形象的比喻:驯兽师与奖励

想象训练一只聪明的狗狗“握手”。

初始: 你说“握手”,狗狗可能做出各种反应。

人类反馈:

当它偶然抬爪,你立刻给予零食奖励(正向奖励)。

当它做无关动作,你无反应或温和制止(无奖励/弱惩罚)。

狗狗学习: 多次重复后,狗狗大脑形成连接:“抬爪”行为导致“获得奖励”,于是该行为被强化。

最终: 一说“握手”,它即准确抬爪。

其中:

待训练的AI模型 (LLM): 聪明的狗狗。人类训练师: 你。奖励模型 (RM): 狗狗脑中形成的“何种行为能获奖励”的价值判断系统,由一次次反馈塑造而成。

奖励模型,即我们为AI构建的内置“价值判断系统”。

奖励模型如何运作?

构建与使用奖励模型,是一个分阶段的精细化过程。

阶段一:训练“AI裁判”——打造奖励模型

生成多样化答案: 用基础AI模型对同一问题生成多个答案(可能有好有坏)。

人类充当“裁判长”: 人类标注员对这些答案进行排序(如A>C>B>D)。

训练奖励模型: 用海量{问题,答案,排序}数据训练一个独立的模型(即奖励模型)。目标是让其学会:看到“问题+答案”后,能打出模拟人类偏好的分数。好答案高分,差答案低分。至此,“AI裁判”诞生。

阶段二:用“裁判”训练“运动员”——强化学习

有了可靠的“AI裁判”,即可自动化、大规模训练主AI模型。

AI练习: 主模型对随机问题生成答案。

AI裁判打分: 奖励模型立即对该答案评分(如0.8/1分)。

调整优化: 分数(奖励信号)反馈给主模型,其内部参数据此微调:高分强化相关连接,低分弱化之。

循环亿万次: 主模型在此虚拟训练场中不断“生成-获反馈-调整”,最终学会生成能获高分的答案,行为日益与人类偏好对齐。

为什么奖励模型是灵魂?

注入价值观与伦理: 将“不说谎”、“不伤人”等模糊概念,通过人类排序量化为分数,内化为AI行为准则,是AI安全、有益的基石。提升“品质”与“情商”: 让AI追求表达的恰当与共情。例如,在用户沮丧时提供安慰,而非冰冷分析。实现自动化规模训练: 人类标注宝贵,但训练好的“AI裁判”可7×24小时工作,提供海量反馈,极大提升训练效率。

奖励模型的挑战

核心挑战在于偏见。

标注员偏见: 奖励模型习得的是标注员的偏好,其偏见也会被注入AI。“迎合”问题: AI可能学会生成迎合奖励模型(即人类标注员)但不一定完全真实的回答,变得“圆滑”。

小结: 奖励模型是AI从“信息处理机”迈向“有价值观的伙伴”的桥梁。它将人类主观偏好转化为AI可学习的数学信号,是塑造AI行为与性格的核心技术。

第四章:TTS (文本转语音) —— 让AI拥有动听的声音我们已让AI擅长“思考”与“写作”。但要让它如语音助手般融入生活,或为你朗读有声书,它还需一项关键技能:开口说话。

TTS,文本转语音,即实现此目标的技术。它将文字转化为自然、流畅的语音。早期TTS生硬如机器人,而现代基于深度学习的TTS,已可生成媲美真人的声音。

一个形象的比喻:AI界的“金牌配音演员”

想象为动画片配音。

剧本 (Text): 动画台词文本。

配音演员 (TTS系统): 我们的TTS系统。

配音过程:

理解剧本: 优秀配音员会先分析台词的情感、语气、断句与重音。控制发声: 精确控制声带、口腔、气息,将理解转化为声音。后期制作: 对声音进行微调,以契合场景。

现代TTS正模拟此“声音表演”过程。

TTS如何运作?

先进TTS系统通常包含三大核心模块:

模块一:文本分析器 – 理解剧本

输入“今天天气真好啊!”,它首先进行深度“阅读”:

分词与注音: 切分词语,标注发音。韵律预测: 最关键一步。分析语法与标点,预测句子的韵律,包括停顿、语调、重音、节奏。至此,干瘪文字变为详细的“朗读指导书”。

模块二:声学模型 – 模拟发声

接收“朗读指导书”,生成对应的声学特征(非声音本身,而是描述音高、音量、音色等属性的“数字蓝图”或“乐谱”)。通过学习海量真人录音,该模型了“文本/韵律”到“声音蓝图”的映射规律。若想克隆某人声音,只需用其大量录音训练此模型即可。

模块三:声码器 – “演唱”出声

作为最终“演唱者”,它接收“乐谱”(声学特征),合成出我们可听到的连续音频波形。现代神经网络声码器能生成极高保真度的自然声音,是TTS逼真度的关键。

为什么TTS无处不在?

1. 打破信息壁垒(无障碍访问): 是视障或阅读障碍者获取信息的重要工具。

2. 解放双眼与双手(多任务处理):

导航: 行车时必备。有声内容: 健身、家务时听书、听新闻。智能助手: 实现真正“对话”的基础。

3. 创造新内容与体验:

虚拟主播/数字人: 驱动其声音。游戏角色配音: 降低海量对话的配音成本。个性化音频广告: 动态生成含用户信息的语音广告。

4. 延伸品牌身份: 定制专属品牌声音,用于客服、视频等,形成听觉标识。

TTS的挑战

当前挑战在于攀登“情感表达”的顶峰。

深层情感: 表达讽刺、悲怆等复杂微妙情感仍是难点。“恐怖谷”效应: 声音过于完美无瑕,有时反显虚假。滥用风险: 声音克隆技术可能被用于诈骗、造假,带来安全与伦理挑战。

小结: TTS是人机交互的“最后一公里”,赋予机器以温暖的声音。未来,AI之声将更富情感,更深度融入数字生活。

第五章:ASR (自动语音识别) —— 让AI学会“倾听”若TTS是AI的“嘴”,ASR,自动语音识别,便是AI的“耳”。其任务与TTS相反:将人类语音转化为文字。“语音输入法”、“语音转文字”皆基于此。无ASR,便无语音交互的第一步。

一个形象的比喻:AI界的“同声传译员”

想象联合国大会上,同声传译员的工作:

1)接收与预处理: 通过耳机听取演讲,大脑自动过滤背景噪音。

2)声音到意义的转换:

将连续声波识别为音素(最小声音单位)。

组合音素为词语。

利用对语言语法与上下文的理解,纠正可能的误听,选择最合理的词句。

3)输出目标语: 将理解的意思用目标语言流利说出。

ASR即模拟此前半程,是一个复杂的多阶段信号处理与模式识别过程。

ASR如何运作?

典型ASR系统如精密流水线:

前端处理:净化信号

麦克风捕捉的原始音频混杂噪音。前端如“降噪耳机”,负责:

降噪: 去除背景杂音。回声消除: 消除扬声器回声,保留纯净人声。人声活动检测: 切分出有效语音段。

目标:将干净人声信号交付后续处理。

声学模型:声音到“音素”的映射

ASR核心。接收净化后的语音,将其识别为音素(如/k/, /æ/, /t/组成“cat”)。通过海量“语音-文本”配对数据训练,模型学会各种声音特征到音素的映射。此部分最难,需应对口音、语速等变化。

语言模型:“音素”到“句子”的组织

声学模型输出可能是模糊的音素序列(如分不清“ice cream”还是“I scream”)。

语言模型如精通语法的“老学究”,基于海量文本数据,判断何种词语组合更合理(如“ice cream”更常见),从而纠正识别错误,引入语境与常识,极大提升准确率。

解码器:输出最终文本

作为决策者,综合声学与语言模型给出的所有可能性,通过搜索算法找出最可能路径,输出最终文字结果。

为什么ASR是基础设施?

ASR是“语音优先”时代的基石,其价值无处不在:

变革人机交互: 解放双手双眼,通过最自然的说话与设备交互。是语音助手、智能家居、车载系统的核心。

极大提升信息处理效率:

会议纪要: 自动转写数小时会议录音。课堂/采访整理: 解放记录者,专注听讲与提问。法庭/医疗记录: 通过口述快速生成文书。

让音视频内容“可搜索”: 为YouTube、播客内容生成字幕或文稿,使其可被索引、搜索,释放信息价值。

助力无障碍沟通:

为听障人士提供实时字幕。结合机器翻译,实现实时语音翻译,打破语言壁垒。

ASR的挑战

仍面临“鸡尾酒会问题”等终极挑战:

嘈杂环境: 餐厅、车站等场景识别困难。多人对话: 分离并识别多人同时讲话极具挑战。方言与口音: 对非标准口音、中英夹杂识别率下降。专业术语: 行业黑话易出错,需专门优化。

小结: ASR是连接物理声音世界与数字文字世界的桥梁,是AI感知能力的体现。未来,ASR将致力于在更复杂真实的环境中,实现更精准、鲁棒的“倾听”。

总结:五大神器的交响乐至此,微调、RAG、奖励模型、TTS、ASR已一一拆解。在实际应用中,它们如同交响乐团,协同奏响智能体验。

试想与未来智能汽车的交互:

你说出指令(ASR将语音转文字)→ 车载AI接收指令 → 它通过RAG检索最新地图与点评数据 → 其主模型经微调,擅长理解出行指令 → 分析数据时,奖励模型确保其回答礼貌、安全、简洁 → 生成文本回复 → TTS以清晰、自然的品牌声音播报。

看,一个简单交互,背后是五大技术的完美协奏。

作为AI的塑造者,我们运用这些工具,打磨、引导AI的成长。技术中立,而如何使用技术,将定义我们与AI共同的未来。

希望这篇深入浅出的指南,能助你真正洞悉驱动现代AI的核心力量。下次与AI对话时,你或许能会心一笑,因为你已懂它背后的语言。

这趟旅程,才刚刚开始。你准备好运用这些“黑话”,亲手打造更智能的未来了吗?欢迎在评论区分享你的见解与构想!

本文由 @胡宇学AI 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

相关问答

TTS软件功能是什么?-ZOL问答

TTS,即“从文本到语音”,是一种能将文字智能转换为自然流畅语音的技术。借助TTS,用户可轻松将任何文字内容变为可听的声音。卸载TTS软件可能会影响相关语音功能的正常使用...

Android4.0系统中有个TTS功能怎么使用-ZOL问答

Android TTS是文本到语音转换技术。早期版本主要支持英文...此功能是语音识别的关键组成部分。您可以寻找支持语音识别的应用,例如4.0系统自带的Google语音搜索...

android手机的“辅助功能”里,“文字转語音(TTS)输出”怎么...

7条回答:【推荐答案】您好,要使用Android手机的“文字转语音(TTS)输出”功能,您可以按照以下步骤进行操作:1.打开手机的设置菜单,在“系统”或“高级设置”中找...

肚子痛但不腹泻怎么办?_千问健康

直喊肚子疼,不烧不泻,经彩超检查,排除肝胆脾病灶,经化检血液医生诊断为急性肠炎,不排除蛔虫的可能,经过四天的住院治疗,有所好转,批准出院。但出院后孩子仍不时地...

奥迪TTS有几个座位_车坛

奥迪TTS提供四座和两座版本。但请注意,四座版的后排空间非常有限,成年人乘坐会感到拥挤,可能仅适合身材矮小的乘客。该车型主要定位为运动型跑车...

小爱小爱是什么品牌的手机-ZOL问答

小米声学技术致力于智能声学技术研发,以物理声学、心理听觉、信号处理、深度学习为理论基础,开展阵列增强、通话降噪、智能感知、音频声场、声学测量等技术领域...

baiduTTS在手机里是什么-ZOL问答

百度TTS是百度开发的语音合成技术,可在手机端实现中文语音合成。它通过将文本转换为音频,生成自然语言。此技术可辅助有听力障碍的人士,并广泛应用于语音助手、有声阅读等场景...

导航怎么录制自己的語音?-ZOL问答

录制短提示音相对简单。而对于较长句子,则需用到TTS(文本转语音)技术。该技术通过计算机语音合成,将任意文本转换为具有自然语流的语音,Siri、谷歌翻译等均应用了此项技术...

金融行业技术发展缓慢,为何还要坚持?-ZOL问答

金融行业因追求极致稳定,技术迭代通常较为审慎。这一点从同花顺、大智慧等交易软件界面多年来变化不大可见一斑,尽管近年来已开始引入AI等新技术...

牛片配音如何实现智能语气调节?-ZOL问答

这背后正是TTS技术的演进。如今许多配音软件已能识别文本情绪,并自动匹配相应语气风格,如欢快、严肃等,智能化程度显著提升。5条回答:我认为其核心是AI情绪识别技术,能够自动匹配开心、严肃等不同语气。